آموزش پیاده سازی سایت روی چند سرور؛ راهنمای توزیع بار و افزایش پایداری

آموزش پیاده سازی سایت روی چند سرور

بسیاری از مدیران سایتهای موفق زمانی به نقطه بحرانی میرسند که یک سرور قدرتمند نیز دیگر پاسخگوی حجم درخواستهای ورودی نیست. در این مرحله، ارتقای سختافزاری سرور فعلی که به آن مقیاسپذیری عمودی میگویند، نه تنها هزینههای گزافی به همراه دارد، بلکه ریسک تکنقطه شکست را نیز از بین نمیبرد. راهکار حرفهای در این شرایط، پیاده سازی سایت روی چند سرور است. این رویکرد به شما اجازه میدهد تا ترافیک را بین چندین نود تقسیم کنید و پایداری سایت را به صد در صد نزدیک کنید. در این مقاله، از صفر تا صد فرآیند انتقال از یک محیط تکسرور به یک کلاستر چندسروری را بررسی میکنیم.

مفاهیم پایه در معماری چندسروری و کلاسترینگ

پیش از شروع مراحل اجرایی، باید درک درستی از نحوه تعامل سرورها در یک شبکه توزیع شده داشته باشیم. در این ساختار، هدف اصلی این است که کاربر نهایی متوجه نشود درخواست او توسط کدام سرور پاسخ داده میشود.

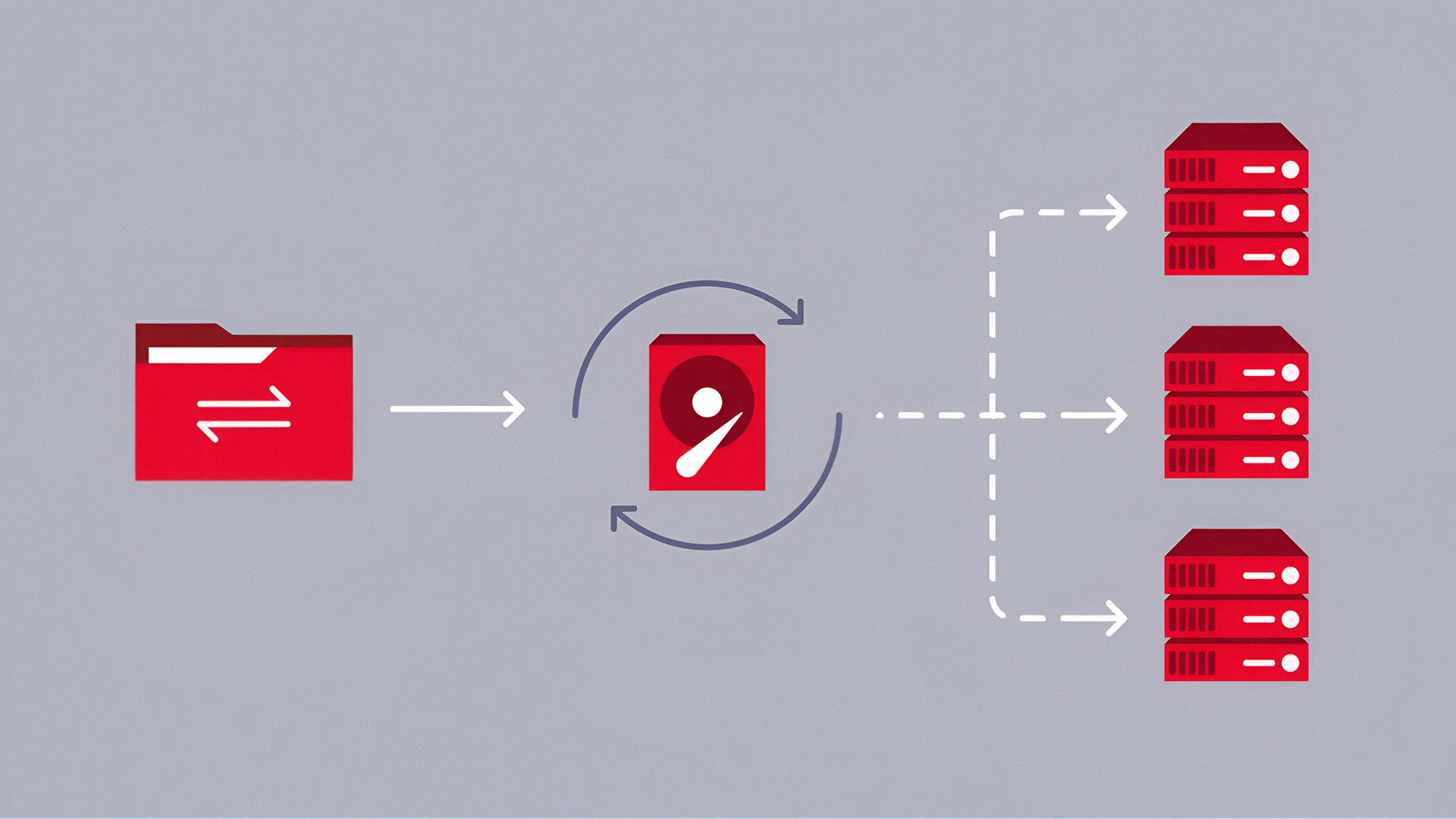

نقش Load Balancer به عنوان دروازه اصلی

اولین و مهمترین بخش در پیاده سازی سایت روی چند سرور، وجود یک متعادلکننده بار یا همان Load Balancer است. این سرویس به عنوان یک پیشانی برای مجموعه سرورهای شما عمل میکند. تمام درخواستهای کاربران ابتدا به Load Balancer میرسد و سپس بر اساس الگوریتمهای مشخص، به یکی از سرورهای اپلیکیشن هدایت میشود. این کار از فشار بیش از حد بر روی یک سرور خاص جلوگیری کرده و تاخیر در پاسخدهی را به حداقل میرساند.

مفهوم پایداری و High Availability در کلاسترینگ

زمانی که از چند سرور استفاده میکنید، سیستم شما به قابلیت دسترسیپذیری بالا مجهز میشود. به این معنا که اگر یکی از سرورها به دلیل نقص فنی یا سوختن قطعات سختافزاری از مدار خارج شود، Load Balancer به صورت خودکار متوجه عدم پاسخدهی آن شده و ترافیک را به سایر سرورهای سالم هدایت میکند. این موضوع بر اعتماد مشتریان تاثیر مستقیمی دارد، چرا که سایت عملا هیچگاه با دانتایم مواجه نمیشود.

انتخاب زیرساخت مناسب برای نودهای کلاستر

هنگام طراحی لایههای مختلف کلاستر، انتخاب نوع ماشینها بستگی مستقیم به سطح ترافیک و بودجه پروژه دارد. برای بسیاری از کسبوکارهای در حال رشد، استفاده از چند نود سبک و سریع در کنار هم، بسیار منطقیتر از خرید یک ماشین غولآساست. در مراحل اولیه اسکیل کردن، بررسی گزینههایی مانند سرور مجازی سرور.آیآر به شما این امکان را میدهد که چندین نود اپلیکیشن را با هزینه کنترل شده راهاندازی کرده و یک کلاستر اولیه برای توزیع بار ایجاد کنید. این رویکرد اجازه میدهد تا با افزایش تدریجی ترافیک، نودهای جدید را به سادگی به Load Balancer معرفی کنید.

بررسی دقیق الگوریتمهای توزیع بار در لایههای ۴ و ۷

توزیع بار فقط به معنای تقسیم درخواستها نیست؛ بلکه انتخاب هوشمندانه نود هدف بر اساس نوع درخواست اهمیت دارد.

توزیع بار در لایه ۴ (Transport Layer): در این سطح، Load Balancer بر اساس اطلاعات پروتکلهای TCP و UDP تصمیمگیری میکند. این روش سرعت بسیار بالایی دارد زیرا محتوای بسته را باز نمیکند و فقط بر اساس IP و پورت، ترافیک را هدایت میکند. این متد برای سیستمهایی که حجم تراکنش بالایی دارند اما نیاز به تحلیل محتوا ندارند، بسیار بهینه است.

توزیع بار در لایه ۷ (Application Layer): این روش هوشمندتر است و Load Balancer میتواند بر اساس محتوای درخواست (مانند هدرهای HTTP، کوکیها یا مسیر URL) تصمیم بگیرد. مثلا میتوانید درخواستهای مربوط به تصاویر را به یک دسته از سرورها و درخواستهای مربوط به دیتابیس را به دسته دیگر بفرستید. در پیاده سازی سایت روی چند سرور به صورت حرفهای، معمولا از ترکیبی از این دو لایه استفاده میشود تا بالاترین بهرهوری سختافزاری حاصل شود.

مدیریت دیتابیس در معماری چندسروری

یکی از بزرگترین چالشها در زمان خروج از محیط تکسرور، نحوه تعامل با دیتابیس است. شما نمیتوانید روی هر سرور یک دیتابیس مجزا داشته باشید، زیرا دادهها با هم ناهماهنگ میشوند.

پیاده سازی دیتابیس متمرکز یا کلاستر شده

در گام اول، معمولا دیتابیس به یک سرور قدرتمند و مجزا منتقل میشود که تمام سرورهای اپلیکیشن به آن متصل میشوند. برای پروژههای حساس که حجم تراکنشهای دیتابیس در آنها بسیار بالاست، پایداری سختافزار حرف اول را میزند. در این سطح، بسیاری از مدیران فنی ترجیح میدهند با خرید سرور اختصاصی، یک محیط کاملا ایزوله و با منابع اختصاصی برای دیتابیس فراهم کنند تا گلوگاههای ناشی از اشتراک منابع در لایه ذخیرهسازی به کلی حذف شود.

پیاده سازی مکانیزم Replication و معماری توزیع شده

برای جلوگیری از توقف سایت در صورت خرابی سرور دیتابیس، از Replication استفاده میشود. در مدل Master-Slave، دادهها در لحظه از سرور اصلی به سرورهای فرعی کپی میشوند. اگر سرور اصلی از دسترس خارج شود، یکی از اسلیوها جای آن را میگیرد. این ساختار نه تنها پایداری را بالا میبرد، بلکه با تقسیم کوئریهای خواندن (Read) روی سرورهای مختلف، سرعت پاسخدهی سایت به شدت افزایش مییابد.

همگامسازی فایلها و استفاده از Shared Storage

وقتی سایت شما روی چندین سرور اجرا میشود، ذخیرهسازی فایلها روی هارد دیسک محلی هر سرور یک اشتباه استراتژیک است.

در پیاده سازی سایت روی چند سرور، باید از یک سیستم ذخیرهسازی مشترک استفاده کنید. راهکار ساده استفاده از NFS (Network File System) است که در آن یک پارتیشن مشخص از طریق شبکه بین تمام سرورها به اشتراک گذاشته میشود. اما برای پروژههای بزرگتر، استفاده از Object Storage یا سیستمهای توزیعشده مثل Ceph پیشنهاد میشود. این سیستمها تضمین میکنند که فایلهای آپلود شده توسط کاربران، فارغ از اینکه درخواست به کدام سرور ارسال شده، در کسری از ثانیه در تمام نودها در دسترس باشند.

مدیریت نشستهای کاربری (Session Management)

در معماری تکسروری، نشستها روی رم یا دیسک همان سرور ذخیره میشوند. اما در معماری چندسروری، اگر کاربر در درخواست اول به سرور ۱ وصل شود و در درخواست دوم به سرور ۲، سیستم او را شناسایی نمیکند و از حساب کاربری خارج میشود.

برای حل این مشکل دو راهکار وجود دارد:

- Session Stickiness: در این حالت، Load Balancer بر اساس آیپی کاربر، او را همیشه به همان سروری میفرستد که بار اول به آن وصل شده بود. این روش ساده است اما اگر آن سرور خاص دان شود، نشست کاربر از بین میرود.

- Centralized Session Storage: راهکار اصولی، استفاده از یک دیتابیس In-memory مثل Redis است. در این حالت تمام سرورها، اطلاعات نشست را از این سرور مرکزی میخوانند. به این ترتیب حتی اگر نودِ سرویسدهنده تغییر کند، کاربر هیچ تغییری حس نخواهد کرد.

استفاده از زیرساخت ابری برای انعطافپذیری کلاستر

گاهی اوقات ترافیک سایت به صورت پیشبینی نشده جهش پیدا میکند، مثلا در زمان جشنوارههای فروش یا کمپینهای تبلیغاتی. در چنین شرایطی، اضافه کردن سرور فیزیکی جدید فرآیندی زمانبر است. استفاده از راهکارهای منعطف مانند سرور ابری سرور.آیآر به شما این قدرت را میدهد که در کمتر از چند دقیقه، نودهای جدیدی را به کلاستر خود اضافه کرده و بار اضافی را مدیریت کنید. این قابلیت الاستیک بودن زیرساخت، تضمین میکند که سایت شما تحت هر شرایطی سریع و در دسترس باقی بماند.

بهینهسازی شبکه داخلی و تاخیر ارتباطی (Latency)

در یک کلاستر چندسروری، حجم تبادل داده بین Load Balancer، سرورهای اپلیکیشن و دیتابیس بسیار زیاد است. اگر شبکه بین این سرورها سرعت کافی نداشته باشد، تاخیر در پاسخدهی سایت به شدت بالا میرود.

بنابراین، سرورها باید در یک زیرشبکه (Subnet) اختصاصی قرار گیرند و از طریق کارت شبکههای با پهنای باند بالا (۱۰ گیگابیت یا بیشتر) با هم در ارتباط باشند. استفاده از سوئیچهای مدیریتشده و ایزولهسازی ترافیک داخلی از ترافیک اینترنت، علاوه بر افزایش امنیت، باعث میشود که فرآیند پیاده سازی سایت روی چند سرور با کمترین تاخیر ممکن عملیاتی شود.

استراتژیهای Deployment و بروزرسانی کلاستر

یکی از چالشهای بزرگ در مدیریت چند سرور، نحوه آپدیت کردن کدهای سایت است. شما نمیتوانید کد را به صورت دستی روی تکتک سرورها کپی کنید، زیرا ممکن است در طول فرآیند، نسخههای متفاوتی از کد روی سرورها اجرا شود که منجر به خطاهای منطقی میشود.

استفاده از ابزارهای اتوماسیون مثل Ansible یا پلتفرمهای CI/CD برای استقرار همزمان کد الزامی است. روش Blue-Green Deployment بهترین گزینه است؛ در این روش شما یک کلاستر جدید با کد جدید ایجاد میکنید و پس از تست کامل، Load Balancer را به سمت کلاستر جدید سوییچ میکنید. این کار باعث میشود بروزرسانیها بدون حتی یک ثانیه قطعی انجام شوند.

مانیتورینگ متمرکز و تحلیل لاگها

وقتی با چندین سرور سر و کار دارید، بررسی دستی لاگها برای یافتن خطاها غیرممکن است. شما به یک سیستم Centralized Logging نیاز دارید که تمام لاگهای وبسرور، اپلیکیشن و دیتابیس را در یک داشبورد واحد جمعآوری کند.

پشته یا همان استک ELK (Elasticsearch, Logstash, Kibana) ابزار استانداردی برای این کار است. همچنین مانیتورینگ منابع سرور باید به گونهای باشد که قبل از رسیدن پردازنده به صد درصد، به مدیر سیستم هشدار دهد. مانیتورینگ دقیق به شما کمک میکند تا بفهمید چه زمانی نیاز به اضافه کردن نود جدید به کلاستر دارید و کدام بخش از زیرساخت گلوگاه اصلی سرعت سایت شماست.

امنیت در لایه شبکه و محافظت از کلاستر

در معماری چندسروری، هر نود یک درب ورود احتمالی برای نفوذگران است. برای امنیت حداکثری، باید از رویکرد Defense in Depth استفاده کرد.

سرورهای اپلیکیشن و دیتابیس نباید دارای آیپی عمومی (Public IP) باشند. تنها Load Balancer است که در معرض اینترنت قرار دارد. تمام ارتباطات دیگر باید در شبکه خصوصی و از طریق فایروالهای سختافزاری کنترل شوند. همچنین استفاده از سرویسهای IDS/IPS برای شناسایی رفتارهای مشکوک در شبکه داخلی کلاستر، لایهای از محافظت را فراهم میکند که در میزبانیهای معمولی وجود ندارد.

مدیریت پهنای باند و کشینگ در سطح کلاستر

برای کاهش فشار روی سرورهای اپلیکیشن، استفاده از یک لایه کشینگ مثل Varnish یا Nginx Cache در جلوی Load Balancer بسیار موثر است. این لایه درخواستهای تکراری برای محتوای ایستا (Static) را مستقیما پاسخ میدهد و اجازه نمیدهد این درخواستها به سرورهای اصلی برسد. این کار پهنای باند داخلی کلاستر را آزاد کرده و اجازه میدهد نودها فقط روی پردازشهای سنگین و منطق برنامه تمرکز کنند.

نتیجهگیری؛ پایداری در مقیاس بزرگ

پیاده سازی سایت روی چند سرور یک گام بزرگ برای عبور از محدودیتهای فنی و ورود به دنیای حرفهای وب است. این ساختار نه تنها پایداری و سرعت سایت را تضمین میکند، بلکه به کسبوکار شما اجازه میدهد تا بدون نگرانی از محدودیتهای سختافزاری، به رشد خود ادامه دهد. هرچند پیادهسازی و نگهداری چنین زیرساختی نیازمند دانش تخصصی و مانیتورینگ مداوم است، اما اطمینانی که از در دسترس بودن همیشگی سایت حاصل میشود، بزرگترین سرمایه برای هر برند آنلاین خواهد بود. استفاده از تجهیزات استاندارد و دیتاسنترهای معتبر، زیربنای اصلی این موفقیت فنی است.

سوالات متداول

وقتی ترافیک سایت از توان پردازشی یک سرور فراتر میرود، سایت با کندی یا قطعی مواجه میشود. استفاده از چند سرور باعث توزیع بار کاری، حذف تکنقطه شکست و تضمین پایداری سایت حتی در صورت خرابی یکی از سختافزارها میشود.

Load Balancer به عنوان دروازه ورودی عمل کرده و درخواستهای کاربران را طبق الگوریتمهای مشخص بین سرورهای موجود در کلاستر توزیع میکند تا هیچ سروری زیر فشار بیش از حد قرار نگیرد.

از آنجایی که هر درخواست ممکن است به سرور متفاوتی برود، باید نشستها را در یک منبع متمرکز مانند Redis ذخیره کرد یا از قابلیت Session Stickiness در Load Balancer استفاده کرد تا کاربر از حساب خود خارج نشود.

خیر، تمام سرورهای اپلیکیشن باید به یک دیتابیس متمرکز یا یک کلاستر دیتابیس متصل باشند تا دادهها همگام باقی بمانند. معمولا برای دیتابیس از یک سرور اختصاصی با منابع بالا استفاده میشود.

مقیاسپذیری عمودی یعنی قویتر کردن قطعات یک سرور واحد، اما مقیاسپذیری افقی یعنی اضافه کردن سرورهای بیشتر به شبکه. مقیاسپذیری افقی محدودیت فیزیکی ندارد و پایداری بیشتری ایجاد میکند.

بهترین راهکار استفاده از یک فضای ذخیرهسازی مشترک مانند NFS یا Object Storage است تا تمام نودهای کلاستر به یک منبع واحد برای خواندن و نوشتن فایلها دسترسی داشته باشند.

زمانی که دیتابیس شما حجم تراکنش بسیار بالایی دارد یا نیاز به امنیت و ایزولهسازی کامل منابع در لایه ذخیرهسازی دارید، اختصاص دادن یک سرور فیزیکی مجزا برای دیتابیس بهترین عملکرد را ارائه میدهد.

با استفاده از استراتژیهای استقرار مانند Blue-Green، ابتدا نسخه جدید روی نودهای رزرو تست شده و سپس ترافیک به صورت آنی توسط Load Balancer به سمت سرورهای جدید هدایت میشود.

شما میتوانید دیدگاه خود را در مورد این مطلب با ما با اشتراک بگذارید.